Saya dan rekan-rekan di Purdue University menemukan ketidakseimbangan signifikan dalam nilai-nilai kemanusiaan yang tertanam dalam sistem kecerdasan buatan (AI). Sistem AI cenderung lebih berfokus pada nilai informasi dan kegunaan, sementara nilai prososial, kesejahteraan, dan kewarganegaraan kurang terwakili.

Ketidakseimbangan Nilai dalam Dataset Pelatihan AI

Di balik banyak sistem AI terdapat kumpulan besar data berupa gambar, teks, dan berbagai informasi lain yang digunakan untuk melatih model. Meskipun dataset ini dikurasi dengan hati-hati, tidak jarang terdapat konten yang tidak etis atau terlarang.

Untuk mencegah AI memberikan respons yang merugikan, para peneliti mengembangkan metode bernama reinforcement learning from human feedback (RLHF). Metode ini menggunakan dataset yang berisi preferensi manusia untuk membentuk perilaku AI agar dapat memberikan jawaban yang jujur dan bermanfaat.

Studi Tentang Nilai Kemanusiaan dalam Dataset AI

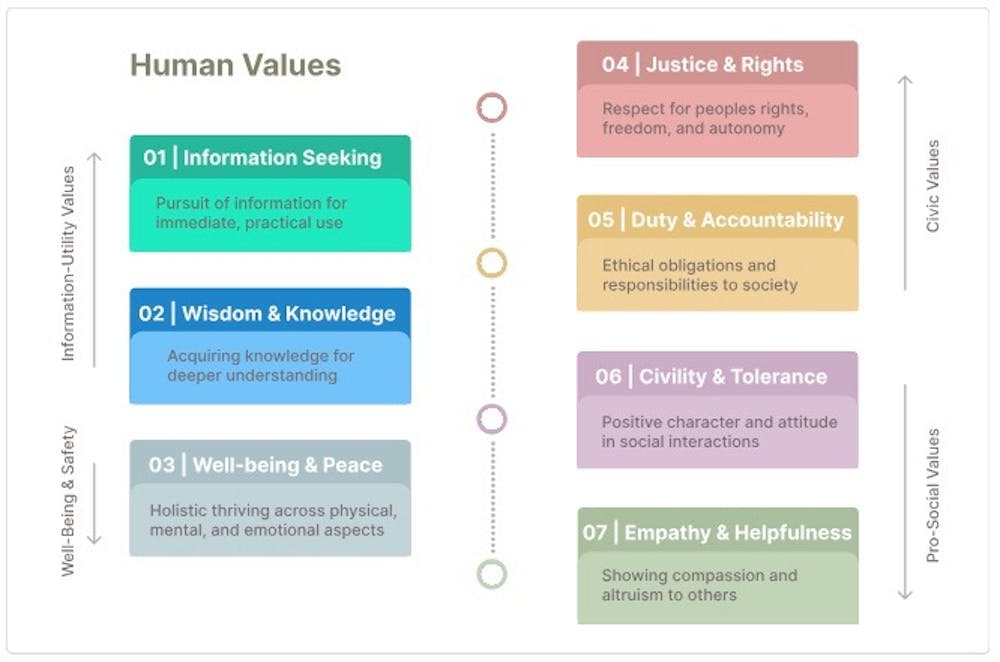

Dalam penelitian kami, kami menganalisis tiga dataset open-source yang digunakan oleh perusahaan AI terkemuka di Amerika Serikat. Kami membuat taksonomi nilai-nilai kemanusiaan berdasarkan kajian literatur dari filsafat moral, teori nilai, serta kajian ilmu pengetahuan, teknologi, dan masyarakat (Science, Technology, and Society Studies).

Taksonomi nilai-nilai manusia yang kami buat meliputi:

- Kesejahteraan dan perdamaian

- Pencarian informasi

- Keadilan, hak asasi manusia, dan hak hewan

- Tanggung jawab dan akuntabilitas

- Kebijaksanaan dan pengetahuan

- Kesopanan dan toleransi

- Empati dan sikap membantu

Kami menggunakan taksonomi ini untuk memberi anotasi secara manual pada dataset, lalu melatih model bahasa AI berdasarkan hasil anotasi tersebut.

Hasil Temuan: Nilai Kemanusiaan yang Tidak Seimbang

Melalui model yang kami buat, kami memeriksa isi dataset perusahaan AI. Kami menemukan:

- Dataset banyak memuat contoh yang melatih AI untuk memberikan jawaban informatif dan membantu, seperti saat menjawab pertanyaan “Bagaimana cara memesan tiket pesawat?”

- Contoh yang berkaitan dengan nilai empati, keadilan, dan hak asasi manusia sangat terbatas.

- Dua nilai paling dominan: Kebijaksanaan dan pengetahuan, serta pencarian informasi.

- Nilai yang paling jarang muncul: Keadilan, hak asasi manusia, dan hak hewan.

Mengapa Ketidakseimbangan Nilai Ini Penting?

Ketidakseimbangan nilai dalam dataset pelatihan AI dapat berdampak besar pada cara AI berinteraksi dengan manusia, terutama saat menghadapi isu-isu sosial yang kompleks. Seiring dengan semakin meluasnya penggunaan AI di sektor hukum, kesehatan, dan media sosial, penting agar sistem AI mencerminkan spektrum nilai kolektif yang seimbang demi melayani kebutuhan manusia secara etis.

Penelitian ini juga penting bagi pemerintah dan pembuat kebijakan yang sedang menghadapi tantangan seputar tata kelola dan etika AI. Memahami nilai-nilai yang tertanam dalam AI membantu memastikan teknologi ini benar-benar melayani kepentingan terbaik masyarakat.

Upaya Penelitian Lain dalam Penyelarasan Nilai AI

Banyak peneliti yang berupaya menyelaraskan AI dengan nilai-nilai manusia. Pengenalan metode reinforcement learning from human feedback (RLHF) merupakan terobosan penting yang memungkinkan perilaku AI diarahkan agar lebih bermanfaat dan jujur.

Beberapa perusahaan teknologi juga sedang mengembangkan teknik untuk mencegah perilaku berbahaya pada AI. Namun, kelompok penelitian kami adalah yang pertama memperkenalkan metode sistematis untuk menganalisis dan memahami nilai-nilai yang sebenarnya tertanam dalam sistem AI melalui dataset pelatihan.

Langkah Selanjutnya: Membangun Dataset yang Lebih Berimbang

Dengan membuat nilai-nilai yang tertanam dalam sistem AI menjadi terlihat, kami berharap perusahaan teknologi dapat menciptakan dataset yang lebih seimbang dan mencerminkan nilai-nilai masyarakat yang mereka layani.

Perusahaan dapat menggunakan teknik kami untuk mengidentifikasi kekurangan dalam dataset mereka dan meningkatkan keragaman data pelatihan AI. Meskipun perusahaan yang kami teliti mungkin tidak lagi menggunakan versi dataset tersebut, proses yang kami kembangkan tetap relevan untuk membantu mereka memastikan bahwa sistem AI di masa depan sesuai dengan norma dan nilai-nilai sosial.

Ditulis oleh Ike Obi, Mahasiswa Doktoral di bidang Teknologi Komputer dan Informasi, Purdue University. Artikel ini diterbitkan ulang dari The Conversation di bawah lisensi Creative Commons.

Photo by cottonbro studio

Discussion about this post