Ketegangan di Balik Inovasi: Momen Krusial yang Menggoyahkan Kemitraan Pentagon dengan Anthropic

Di tengah pusaran inovasi kecerdasan buatan (AI) yang kian pesat, terungkap sebuah cerita dramatis mengenai keretakan hubungan antara Pentagon, lembaga pertahanan Amerika Serikat, dengan Anthropic, salah satu pemain utama di industri AI. Momen-momen krusial, yang digambarkan oleh seorang pejabat Pentagon sebagai ‘holy cow’ atau momen yang mengejutkan, menjadi titik balik yang memicu ketegangan dan pertanyaan mendasar mengenai kolaborasi strategis dalam pengembangan teknologi masa depan.

Potensi AI yang Menggiurkan dan Risiko yang Mengintai

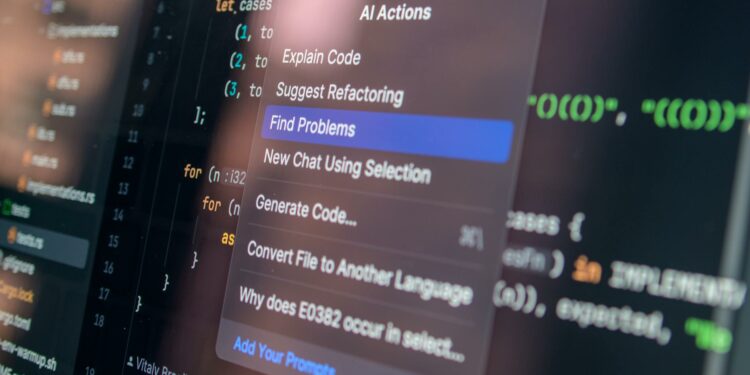

Anthropic, yang didirikan oleh mantan anggota OpenAI, telah menarik perhatian besar berkat kemampuannya dalam menciptakan model AI yang canggih, terutama melalui produk unggulannya, Claude. Potensi AI untuk merevolusi berbagai sektor, termasuk pertahanan, tidak dapat disangkal. Kemampuan analisis data yang cepat, prediksi yang akurat, dan otomatisasi tugas-tugas kompleks membuka jalan bagi efisiensi dan keunggulan strategis yang signifikan.

Namun, seiring dengan janji-janji kemajuan, muncul pula kekhawatiran mendalam. Penggunaan AI dalam konteks militer, terutama dalam sistem senjata otonom atau dalam pengambilan keputusan strategis, membawa implikasi etis dan keamanan yang rumit. Kecepatan perkembangan AI terkadang melampaui kemampuan regulasi dan pengawasan, menciptakan celah yang berpotensi disalahgunakan atau menimbulkan konsekuensi yang tidak diinginkan.

Momen ‘Holy Cow’ yang Mengubah Segalanya

Menurut seorang pejabat senior Pentagon yang enggan disebutkan namanya, ada beberapa momen spesifik yang menimbulkan keterkejutan dan kekhawatiran mendalam. Momen-momen ini, yang dikategorikan sebagai ‘holy cow’ oleh pejabat tersebut, berkaitan dengan bagaimana Anthropic mengelola atau berpotensi menggunakan data dan teknologi yang mereka kembangkan. Detail pasti dari momen-momen ini masih dirahasiakan, namun indikasi mengarah pada kekhawatiran tentang keamanan data, transparansi dalam pengembangan algoritma, atau bahkan potensi penyalahgunaan teknologi AI.

Ketegangan ini tidak muncul secara tiba-tiba. Hubungan antara Pentagon dan perusahaan-perusahaan AI seperti Anthropic memang selalu bersifat kompleks. Di satu sisi, Pentagon membutuhkan akses ke teknologi AI terdepan untuk menjaga keunggulan kompetitifnya. Di sisi lain, perusahaan-perusahaan AI memiliki kekhawatiran mereka sendiri, seperti menjaga kekayaan intelektual, memastikan kebebasan dalam penelitian dan pengembangan, serta menghindari keterlibatan dalam penggunaan teknologi yang dianggap tidak etis.

Dampak pada Kolaborasi dan Kepercayaan

Keretakan ini berpotensi besar mempengaruhi alur kerja dan kolaborasi antara Pentagon dan Anthropic. Kemitraan yang sebelumnya terjalin erat, yang bertujuan untuk memanfaatkan kekuatan AI demi keamanan nasional, kini dihadapkan pada ujian kepercayaan. Pentagon mungkin akan memperketat pengawasan dan persyaratan, sementara Anthropic mungkin merasa tertekan untuk lebih transparan atau bahkan menarik diri dari proyek-proyek tertentu.

Lebih luas lagi, insiden ini menyoroti tantangan inheren dalam mengintegrasikan teknologi AI yang berkembang pesat ke dalam sektor-sektor sensitif seperti pertahanan. Diperlukan keseimbangan yang cermat antara inovasi, keamanan, dan etika. Perusahaan AI perlu menunjukkan tanggung jawab dalam pengembangan dan penerapan teknologi mereka, sementara pemerintah, dalam hal ini Pentagon, perlu memiliki mekanisme pengawasan yang efektif namun tidak menghambat kemajuan.

Langkah ke Depan: Menemukan Titik Temu

Kisah ini bukan hanya tentang Pentagon dan Anthropic, tetapi juga tentang masa depan kolaborasi antara pemerintah dan industri teknologi tinggi. Untuk mengatasi ketegangan semacam ini, diperlukan dialog yang terbuka dan berkelanjutan. Keduanya perlu memahami perspektif masing-masing dan mencari titik temu yang menguntungkan semua pihak.

Ini mungkin berarti pengembangan protokol keamanan data yang lebih ketat, audit independen terhadap algoritma AI, atau bahkan pembentukan kerangka kerja etika bersama. Keberhasilan dalam menavigasi kompleksitas ini akan menentukan sejauh mana potensi AI dapat dimanfaatkan secara aman dan bertanggung jawab untuk kepentingan yang lebih besar, termasuk keamanan dan kemajuan peradaban.

Pejabat Pentagon yang sama menekankan bahwa meskipun ada ketegangan, upaya untuk menemukan solusi tetap berjalan. ‘Kami terus berkomunikasi,’ ujarnya. ‘Tujuannya adalah untuk memastikan bahwa teknologi AI yang sangat kuat ini dikembangkan dan digunakan dengan cara yang benar-benar aman dan menguntungkan.’ Momen-momen ‘holy cow’ memang mengejutkan, namun mereka juga bisa menjadi katalisator untuk perbaikan dan kematangan dalam pengelolaan teknologi masa depan.

Discussion about this post